QCon 2026·MemTensor:OpenClaw 热潮下的 Agent 记忆系统工程实践

主讲:熊飞宇 博士(记忆张量 MemTensor,创始人 & CEO)

时长:约 49 分钟 + 12 分钟答疑

记忆从效率工具变成了 Agent 能否正常运行的生死线。MemTensor 分享了 memOS 的三层记忆分层架构(明文/KV Cache/参数)、两条技术路径的对比选择,以及企业级多 Agent 产品 ClawForce 在部署、经验沉淀和安全治理上的实践。

今天分享三部分

- 做 Memory 和 memOS 的整体思考

- memOS 与 Claude/OpenClaw 如何结合

- 面向企业的多 Agent 产品 ClawForce:多 Agent 协同与安全管控

一、团队背景

MemTensor 团队 2023 年在上海算法创新研究院成立。在此之前我主要在阿里,先后担任阿里业务中台数据团队负责人、浩天集团数据平台负责人,落地了国内首个零售行业大模型,在核心商品和商家业务上有应用。

团队成立时的核心出发点是探索基础原理层面的创新——从模型架构本身出发,思考什么是需要被补足的。我们认为 Transformer 架构本身存在计算复杂度爆炸和上下文窗口的固有缺陷,势必需要更好的架构和系统设计来解决 Memory 问题。所以我们做的第一件事是训练一个记忆分层的基座模型,也就是 MemCube——业界首个做记忆分层的模型。对记忆进行分层处理,现在已经是业界共识,包括 Google 等团队都在积累这个思想。

基于 MemCube 的核心思路和算法,我们构建了 memOS——记忆操作系统,希望从操作系统的维度去管理记忆,达到整体效果最优。

去年获得了年度前 10 的融资,也拿到了很多订单。

二、为什么 Memory 越来越重要

无论是大模型的 Memory 还是 Agent 型 Memory,随着 OpenAI 发布相关功能后都在一路走高。

几个关键推动因素:

Sam Altman 的大力鼓吹:他最早在 ChatGPT 里上线了记忆功能,效果确实很好——模型能记住你,每次回答都结合你的历史。他反复在各种场合推这件事。

**从”效率问题”升级为”生死问题”**:过去我们认为记忆只是提升准确率和召回率的效率工具。但随着 Operator(任务型 Agent)的出现,如果 Agent 的状态不够准确、记不住关键信息,任务就会失败——记忆变成了 Agent 能否正常运行的生死线。大家对这件事的重要性有了全新认知。

上下文复杂度急剧增长:单个用户单轮对话就已经有极其丰富的上下文(工具调用、知识库、外部信息、反馈等)。扩展到多 Agent 规划、MTA(多任务 Agent)、M 台架构后,复杂度急剧增长。需要一个专门的记忆增强层来屏蔽这些复杂操作,这就是我们做 memOS 的核心出发点。

三、记忆增强的五个核心环节

记忆增强链路可以归纳为五个环节:抽取 → 组织 → 检索 → 更新 → 共享。

- 抽取:从对话或企业文档中捕捉关键信息形成记忆片段。哪些内容应该被抽取成记忆?不同行业、不同场景差异很大,比如情感陪伴类 APP 和工业场景的记忆内容大相径庭。

- 组织:如何构建记忆的逻辑和时间关系。

- 检索:按需快速检索相关记忆用于推理生成。

- 更新:记忆有遗忘曲线,如何动态修正、替换过时记忆,保持知识新鲜。

- 共享:多 Agent 时代,知识和记忆之间的共享与隔离——尤其涉及企业安全时至关重要。

另外,LLM 架构天生带来幻觉,而幻觉在记忆这件事上会向后传导——抽取环节一开始搞错了,后面会一路飘偏。这也是 Claude/OpenClaw 这类系统一直用 context 配置方法存在的问题。

四、两条技术路径的对比

业界做记忆增强有两条路径:

路径一:模型内生驱动

通过设计创新的基座架构,在模型底层嵌入记忆机制,改变模型本体。代表工作:Google 的 Memorizing Transformers(2022)、NCBR 的 focused Transformer(2023)、UCSD 的 MemoryLLM(2024)、我们的 MemCube(2024,业界首个记忆分层框架)、浙大团队通过编辑模型参数来编辑记忆等。

优点:上限高,新架构、新训练策略都能带来显著提升。

缺点:成本极高。我们在 2024 年初训练 MemCube 时,只融到了 240 万人民币,用了 A10 显卡跑了半年,供应商问题直到今天也没完全解决。风险很高。

路径二:应用系统驱动

在应用层叠加一套系统来管理交互内容和信息。硅谷这边很多团队在走这条路。

优点:效率高、扩容容易。

缺点:严重依赖 LLM 能力,幻觉问题突出。

我们的选择:结合两者。模型驱动决定上限,应用驱动决定下限。需要从系统层面做多层次记忆的协同和多触点调度,把参数内、KV Cache 中、明文存储中的记忆统一管理,达到读写效率全局最优。

五、memOS 1.0:记忆分层架构

memOS 1.0 的核心是三层记忆分层架构,源自 MemCube 的思想:

| 层级 | 名称 | 特点 |

|---|---|---|

| 上层 | 明文记忆 | 类似 RAG,写入快(修改数据库/文件系统),读取慢(需检索再生成) |

| 中层 | 激活器(KV Cache) | 读写适中,命中率高时响应快、成本低 |

| 底层 | 参数集(模型参数) | 推理速度快,但训练成本高 |

核心思想:把合适的记忆放在合适的位置,实现整体读写效率最优。

基于调度的生命周期管理:举个例子,我和虚拟助手聊天,它知道我喜欢打篮球。对话过程中话题漂移到伊朗局势,系统会根据用户行为预判,提前检索相关新闻存入 KV Cache,保证缓存命中率始终处于高水平,整体效率最优。

图结构组织:记忆之间存在复杂的冲突检验和逻辑结构关系,需要图结构来做更好的组织管理。

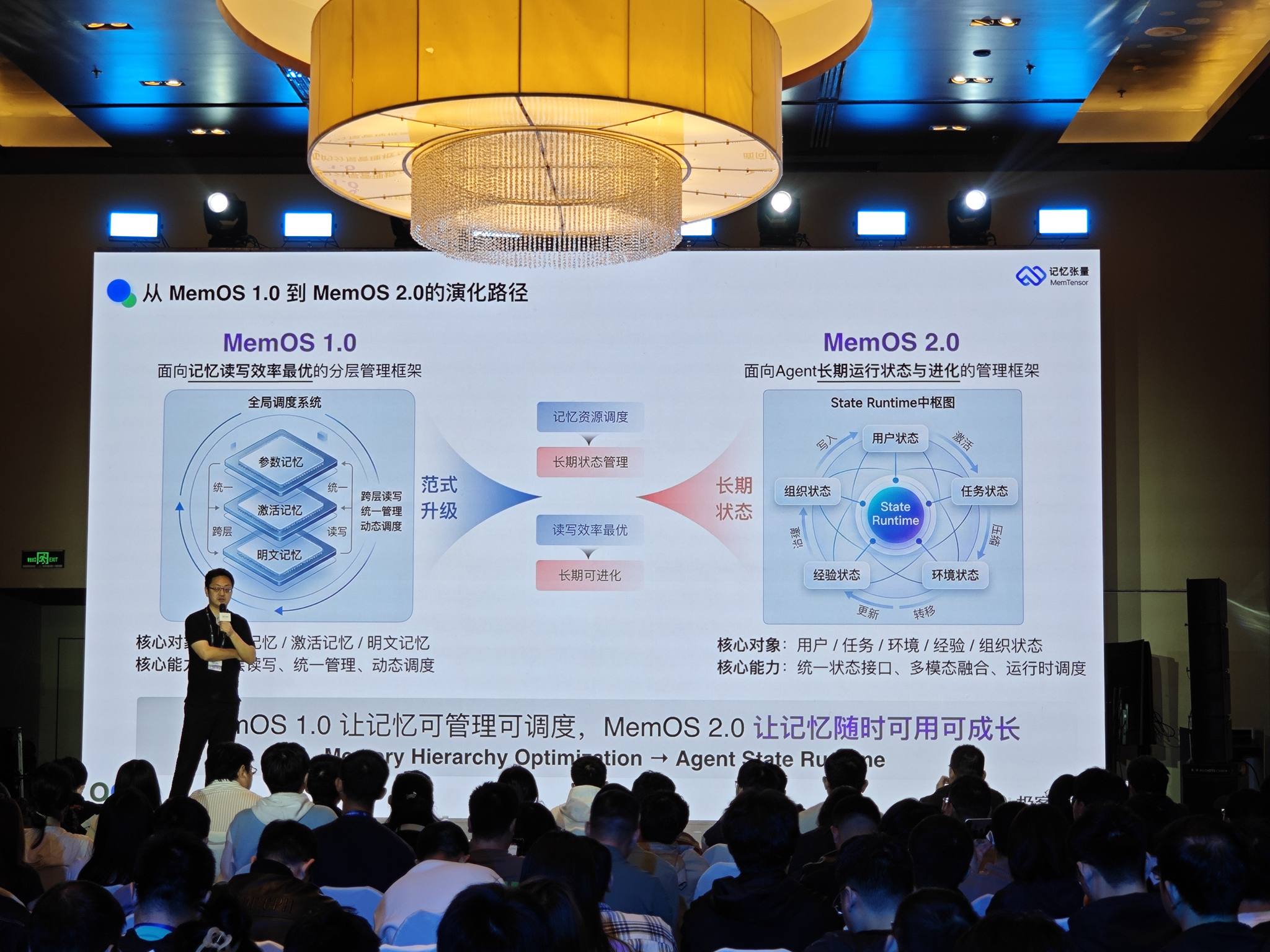

六、memOS 2.0:面向长期运行的 Agent

2024 年 12 月底发布 memOS 2.0,核心解决面向技术效率最优的记忆管理框架。

背景:我们发现很多合作企业(游戏、情感陪伴、工业)内部 Agent 的任务复杂度在逐步升高,需要更好的记忆管理框架来支持 Agent 长期运行和状态进化。2025 年初 OpenClaw 热潮爆发后,memOS 的使用量一路攀升。

三个核心思路:

1. 以用户/Agent 为中心的状态管理

龙虾”养死”的根本原因是它对自己的状态判断很差——任务执行到一半,它觉得完成了就停在那里;或者没执行完这一步,直接跳到下一步。memOS 2.0 重点做:

- 状态感知:实时识别用户/Agent 的行为阶段和环境状态

- 状态判定:评估重要节点,预测未来发展

- 状态进化:记忆不再是查询时的静态对象,而是需要被实时调度的动态资源

2. 记忆版本化管理与进化

对 Agent 执行过程中的状态全量存储,清晰地看到哪些记忆应该被淘汰/替换/遗忘,哪些知识和经验应该被记录下来,从而实现经验沉淀和记忆进化。

3. 持续训练记忆衍生基座模型

记忆不只是外挂系统,还要成为模型能力本身的一部分。在模型架构、训练目标和推理机制中原生支持:信息压缩、检索和跨时间调用。我们在架构层面增加了多个 Memory Head,让模型参数能更好地处理记忆的方方面面。

七、memOS 开源社区

memOS 是开源框架,目前 GitHub Star 数超过 8,300,在快速增长,在同类开源项目中排名靠前。社区现有约 1.5 万开发者,其中约 1,000 来自大型企业。我们联合交大等高校共建 memOS 技术和开源生态,欢迎大家参与。

云服务调用量已超过 100 万次/天,分布:60% 左右是复杂 Agent 类型,28% 是游戏和情感陪伴应用,12% 来自硬件层(消费电子设备)。目前是最大的记忆云服务平台之一。

八、memOS 与 Claude/OpenClaw 插件集成

Claude/OpenClaw 原生记忆的核心问题

Claude/OpenClaw 系统的记忆设计存在几个问题:

- 没有结构化写入:什么时候记什么完全交给模型自己判断,写入稳定性和一致性无法保障,天然会出现漂移

- 记忆与检索分离:符合软件高内聚低耦合的设计理念,但我们认为这两件事不应该被分开——内容未必会被装进上下文,淘汰后的长期记忆未必能正确沉淀

- 过度依赖压缩:过多压缩会损害推理的连贯性,代码细节没有被保留,整个代码仓库可能被冲掉

memOS 从 6 个维度做了提升:

- 存储:从单一向量存储扩展到多模态统一管理

- 检索:从 BM25 + 向量双路召回,升级为 RRF 三路融合 + MMR 多样性设计,在召回多样性和准确性之间取得最优平衡

- 过滤:从简单阈值,升级为语义相似度 → 向量排序 → 大模型判断的三层漏斗

- Skill 提取:新增 memOS Skill 提取功能,从对话数据中自动提取结构化任务,转化为参数化的 Skill

- 可视化:MemoryViewer,全功能可视化面板,让黑盒记忆变透明,支持时间线、空间维度的记忆追踪,以及记忆质量看板(重复率、命中率等)

- 团队协作:支持 Skill 在不同 Agent 之间共享,以及数据隔离

两种插件形态

云插件:API 一键接入,5 分钟完成接入,支持高并发、低延迟、多模态,适合 SaaS 产品快速验证。

本地插件(memOS Local):100% 本地运行,下载安装包即可使用,支持企业私有化部署,适合对隐私有强要求的开发者和企业。

插件架构设计

插件分 6 个模块,3 个同步(环境初始化、上下文组装、记忆处理/压缩/去重)+ 1 个异步(子记忆继承和管理)。实现 0 侵入、全链路覆盖,每个模块可以独立插拔启用/关闭。

核心效果数据

- 大模型评分显著提升

- 3 天内上下文成本下降 30%

- 用户工单交互轮次减少 50%+

- Token 综合节省约 50%

九、企业级产品 ClawForce

ClawForce 是我们在 memOS 之上构建的企业级多 Agent 产品。内部评测:原来开发一个复杂场景需要约半年,使用 ClawForce 后人力大幅下降,开发时间降到约一个半月。

解决的核心痛点:

- 部署:从个人本地部署扩展到 50/100/500 个 Agent 的企业级部署

- 经验沉淀:老员工离职后经验不会流失;以前邮件、审批系统无法自动感知核心节点,需要专人盯——ClawForce 让 Agent 能自动处理这些

- 治理/安全:数据边界、操作追溯、规范审核和回滚

产品架构(从底到顶):

- 底层:memOS 引擎、Skill 引擎、事件/工具链接

- 管理端:IT 团队快速部署、方案下发和持续优化

- 员工端:让员工真正信任和使用 Agent

三个核心 Demo:

1. 新 Agent 快速部署:通过企业知识 + 模型快速生成 Agent 描述,IT 团队核验后配置模型、外挂、Skill,指定给哪些岗位使用及相关策略,完成部署。

2. 组织经验沉淀:以参展方案为例,Agent 处理后自动更新 Skill,触发 Skill 变更审核流程,管理后台可看到变更详情,审核通过后沉淀到组织,并可配置可使用范围。

3. 安全体系:

- 事前:敏感信息过滤、网关侧安全插节点

- 事中:高危操作(群发、批量操作)需二次人工确认

- 事后:异常行为告警、操作日志导出,给企业提供完整的底线保障

多 Agent 协同示例:一个商务同学有销售背景,需要新增一个商务营销 Agent。Agent 持续向商务助手提供热点信息,商务分析 Agent 判断有价值后,跨 Agent 推送给产品经理,推动产品设计。核心是:哪些记忆需要隔离、哪些需要复用、如何确保状态准确。

答疑

问(观众):OpenAI 等大模型厂商自带记忆功能,memOS 作为第三方独立记忆层的生存空间在哪里?

熊飞宇:大模型厂商会把记忆留在自己的产品内,核心是通过记忆做用户留存。OpenAI 甚至用记忆层做登录组件,让其他开发者用 OpenAI 的独立记忆层做用户画像。

我们的核心逻辑是做第三方独立记忆层——让不同端、不同数据之间的记忆能够联通和统一管理,让记忆归属于它应该归属的对象(个人记忆归个人,企业记忆归企业),而不是绑定在单一模型厂商。

现实是应用厂商不会绑定单一模型:做对话用 DeepSeek,做长文本生成用开源模型,做语音用语音专项模型。在多模型协同的现状下,独立于模型之外的记忆层是必然需求,这个格局在现有商业化架构下不会改变。

问(观众):开源版和 SaaS 商业版功能是否一致?开源和商业化是否冲突?

熊飞宇:不冲突。我们现在做的开源会比较彻底,但有时间差——公司成立才一年多,影响力和覆盖面比商业化营收更重要。我们会确保闭源功能在接下来几个月内同步到开源版本,并且 API 几行代码就能接入,对开发者非常友好。

观众(补充):在中国,开源和商业化确实容易被认为冲突,但在海外市场,开源产品是不可能被企业直接采购的,他们必然寻求付费的技术支持和解决方案。另外开源对产品的反馈回路非常重要,在 AI 时代这一点更加关键。

问(观众):未来半年 Agent 记忆方向最值得关注的点是什么?

熊飞宇:最核心的方向是记忆工程(Memory Engineering)——如何让记忆在运行时状态更加准确,让 Agent 更好地执行长期任务。这其实就是现在大家讲的 Harness 的重要组成部分:Agent 能稳定运行,记忆是非常关键的一环。如何让它长期稳定、长期有效、长期准确,是最核心的问题。

问(观众):memOS 里的 Skill 自组织写入,会不会终结人工设计范式?业界好像都在往自动化方向走。

熊飞宇:这个问题本质上是在问 AGI 什么时候到来。在 AGI 到来之前,人还是有非常大的作用。而且即使 AI 能力越来越强,人的能力层次要求也越来越高。你可以看那些自组织框架,它的底层算法是什么?不同组之间的算法关系怎么处理?这些是否也是模型自己设计出来的?——在 AGI 到来之前,这些底层框架和算法逻辑仍然需要人来设计。

问(观众):企业内部各团队处理相似业务逻辑,如何通过记忆共享和融合避免重复劳动?

熊飞宇:不同层级的员工对同一件事的理解不一样——高层级员工看到的数据和视角更多,但这些东西没有被共享。我们的做法是通过算法把高层级员工的记忆和经验,分发给低层级员工,帮助初级员工快速成长。核心在于:Skill 的质量管控(打分、治理)和私域权限管控——什么级别的人有权限使用什么 Skill,最终由企业内部决策。

观众(补充):这其实是一种组织范式的变化。有个 CEO 发现,他的管理杠杆不再是招人或管人,而是去梳理每个岗位的业务流程,把每一步骤的数据写下来,教给员工。这是高层经验向低层员工覆盖的一种新模式。在人机协作业务推进过程中,自然会沉淀出大量数字化资产,这些资产将成为未来企业真正的商业模型。